Η στρατηγική της Deloitte στην τεχνητή νοημοσύνη

Η Deloitte ανακοίνωσε μια σημαντική συμφωνία με την Anthropic για την υιοθέτηση λύσεων τεχνητής νοημοσύνης, την ίδια ημέρα που έγινε γνωστό ότι θα επιστρέψει χρήματα για μια κυβερνητική έκθεση που περιείχε ανακριβή αποτελέσματα παραγόμενα από AI. Η συνεργασία αυτή επιβεβαιώνει τη δέσμευση της Deloitte στην τεχνητή νοημοσύνη, παρά τις προκλήσεις που αντιμετωπίζει με τη νέα τεχνολογία. Η Deloitte δεν είναι η μόνη που καλείται να διαχειριστεί τέτοια ζητήματα.

Η χρονική συγκυρία και οι επιπτώσεις

Η ανακοίνωση της συμφωνίας ήρθε την ίδια μέρα που το Υπουργείο Απασχόλησης και Εργασιακών Σχέσεων της Αυστραλίας γνωστοποίησε ότι η Deloitte θα πρέπει να επιστρέψει χρήματα για μια έκθεση που περιείχε ψευδείς αναφορές λόγω AI. Η έκθεση, αξίας A$439,000, είχε αρκετά λάθη, όπως αναφορές σε ανύπαρκτες ακαδημαϊκές πηγές. Η διορθωμένη έκδοση αναρτήθηκε πρόσφατα στην ιστοσελίδα του υπουργείου και η Deloitte θα επιστρέψει την τελευταία δόση της σύμβασης.

Εφαρμογή του Claude στους εργαζόμενους

Η Deloitte σχεδιάζει να διαθέσει το chatbot Claude της Anthropic σε περίπου 500.000 εργαζόμενους παγκοσμίως. Οι δύο εταιρείες, που συνεργάζονται από πέρυσι, θα αναπτύξουν προϊόντα συμμόρφωσης για ρυθμιζόμενους κλάδους όπως οι χρηματοοικονομικές υπηρεσίες, η υγεία και ο δημόσιος τομέας. Παράλληλα, η Deloitte θα δημιουργήσει διαφορετικές “προσωπικότητες” AI για τα τμήματά της, όπως λογιστές και προγραμματιστές.

Στόχοι και δηλώσεις της Deloitte

Σύμφωνα με τον Ranjit Bawa, επικεφαλής τεχνολογίας και συνεργασιών της Deloitte, η επένδυση στην πλατφόρμα της Anthropic βασίζεται στη σύγκλιση των προσεγγίσεων για υπεύθυνη τεχνητή νοημοσύνη. Ο ίδιος τόνισε ότι το Claude αποτελεί κορυφαία επιλογή τόσο για τους πελάτες όσο και για τον ψηφιακό μετασχηματισμό της εταιρείας.

Προκλήσεις με την ακρίβεια της τεχνητής νοημοσύνης

Η Deloitte δεν είναι η μόνη που έχει βρεθεί αντιμέτωπη με προβλήματα ακρίβειας από συστήματα AI. Τον Μάιο, η εφημερίδα Chicago Sun-Times παραδέχτηκε ότι δημοσίευσε λίστα βιβλίων που δημιουργήθηκε από AI και περιείχε ανύπαρκτους τίτλους. Εσωτερικό έγγραφο της Amazon έδειξε ότι το Q Business είχε δυσκολίες με την ακρίβεια τον πρώτο χρόνο λειτουργίας του. Ακόμη και η Anthropic έχει δεχτεί κριτική για τη χρήση ανακριβών αναφορών από το Claude σε νομικές υποθέσεις.

Meta Llama: Το ανοιχτό μοντέλο γενετικής AI

Όπως και άλλες μεγάλες εταιρείες τεχνολογίας, η Meta διαθέτει το δικό της μοντέλο γενετικής τεχνητής νοημοσύνης, το Llama. Το Llama ξεχωρίζει επειδή είναι “ανοιχτό”, επιτρέποντας στους προγραμματιστές να το κατεβάσουν και να το χρησιμοποιήσουν με ευελιξία, σε αντίθεση με μοντέλα όπως τα Claude, Gemini, Grok και ChatGPT, που είναι προσβάσιμα μόνο μέσω API.

Διαθεσιμότητα και εργαλεία για το Llama

Για να προσφέρει περισσότερες επιλογές στους προγραμματιστές, η Meta συνεργάζεται με παρόχους όπως AWS, Google Cloud και Microsoft Azure, ώστε να διαθέτει το Llama μέσω cloud. Επιπλέον, παρέχει εργαλεία, βιβλιοθήκες και οδηγούς στο “Llama cookbook” για παραμετροποίηση και αξιολόγηση των μοντέλων. Οι νεότερες εκδόσεις, όπως Llama 3 και Llama 4, προσφέρουν υποστήριξη για πολλαπλές μορφές δεδομένων και ευρύτερη διαθεσιμότητα στο cloud.

Τι είναι το Llama;

Το Llama αποτελεί οικογένεια μοντέλων. Η πιο πρόσφατη έκδοση, Llama 4, κυκλοφόρησε τον Απρίλιο του 2025 και περιλαμβάνει τρία μοντέλα:

- Scout: 17 δισεκατομμύρια ενεργές παραμέτρους, 109 δισεκατομμύρια συνολικά, και παράθυρο συμφραζομένων 10 εκατομμυρίων tokens.

- Maverick: 17 δισεκατομμύρια ενεργές παραμέτρους, 400 δισεκατομμύρια συνολικά, και παράθυρο συμφραζομένων 1 εκατομμυρίου tokens.

- Behemoth: Δεν έχει κυκλοφορήσει ακόμη, αλλά θα διαθέτει 288 δισεκατομμύρια ενεργές παραμέτρους και 2 τρισεκατομμύρια συνολικά.

Τι σημαίνει “παράθυρο συμφραζομένων”

Το παράθυρο συμφραζομένων αναφέρεται στον όγκο των δεδομένων που το μοντέλο λαμβάνει υπόψη πριν παράγει απάντηση. Μεγαλύτερο παράθυρο βοηθά το μοντέλο να διατηρεί τη συνοχή και να αποφεύγει παρεκκλίσεις, αλλά μπορεί να μειώσει την αποτελεσματικότητα ορισμένων φίλτρων ασφαλείας.

Εκπαίδευση και αρχιτεκτονική των μοντέλων

Όλα τα μοντέλα Llama 4 εκπαιδεύτηκαν σε τεράστιο όγκο αδημοσίευτων κειμένων, εικόνων και βίντεο, καθώς και σε 200 γλώσσες. Τα Scout και Maverick είναι τα πρώτα ανοιχτά μοντέλα της Meta με εγγενή υποστήριξη πολλαπλών μορφών δεδομένων, βασισμένα σε αρχιτεκτονική “mixture-of-experts” για μεγαλύτερη αποδοτικότητα. Το Behemoth λειτουργεί ως “δάσκαλος” για τα μικρότερα μοντέλα.

Δυνατότητες του Llama

Το Llama μπορεί να εκτελεί διάφορες βοηθητικές εργασίες, όπως προγραμματισμό, απαντήσεις σε μαθηματικά ερωτήματα και σύνοψη εγγράφων σε τουλάχιστον 12 γλώσσες. Υποστηρίζει επεξεργασία κειμένων, εικόνων και βίντεο, ενώ τα διαφορετικά μοντέλα εξειδικεύονται σε συγκεκριμένες χρήσεις: το Scout για ανάλυση μεγάλων δεδομένων, το Maverick για ισορροπία ταχύτητας και λογικής, και το Behemoth για προηγμένη έρευνα και επιστημονικές εφαρμογές.

Ενσωμάτωση με εργαλεία και APIs

Τα μοντέλα Llama μπορούν να συνδεθούν με εφαρμογές τρίτων, όπως Brave Search για ερωτήσεις επικαιρότητας, Wolfram Alpha API για μαθηματικά και επιστημονικά θέματα, και Python interpreter για έλεγχο κώδικα. Αυτές οι δυνατότητες απαιτούν κατάλληλη ρύθμιση.

Πού μπορείτε να χρησιμοποιήσετε το Llama

Το Llama βρίσκεται πίσω από το Meta AI chatbot σε Facebook Messenger, WhatsApp, Instagram, Oculus και Meta.ai σε 40 χώρες. Εκδόσεις του χρησιμοποιούνται σε πάνω από 200 χώρες και περιοχές. Τα Scout και Maverick είναι διαθέσιμα στο Llama.com και σε συνεργάτες όπως το Hugging Face. Οι προγραμματιστές μπορούν να κατεβάσουν, να χρησιμοποιήσουν ή να παραμετροποιήσουν το μοντέλο σε δημοφιλείς cloud πλατφόρμες, με περισσότερους από 25 συνεργάτες φιλοξενίας, όπως Nvidia, Databricks, Groq, Dell και Snowflake.

Περιορισμοί άδειας χρήσης

Η άδεια του Llama περιορίζει τη χρήση του από εφαρμογές με πάνω από 700 εκατομμύρια μηνιαίους χρήστες, οι οποίες πρέπει να λάβουν ειδική άδεια από τη Meta.

Υποστήριξη για startups

Τον Μάιο του 2025, η Meta ξεκίνησε το πρόγραμμα Llama for Startups, προσφέροντας υποστήριξη και πιθανή χρηματοδότηση σε νεοφυείς επιχειρήσεις που υιοθετούν τα μοντέλα Llama.

Εργαλεία ασφαλείας της Meta για το Llama

Η Meta προσφέρει εργαλεία για την ασφαλέστερη χρήση του Llama:

- CyberSecEval: Σουίτα αξιολόγησης κινδύνων στον κυβερνοχώρο.

- Llama Firewall: Εργαλείο για την κατασκευή ασφαλών συστημάτων AI.

- Code Shield: Φιλτράρισμα μη ασφαλούς κώδικα κατά την εκτέλεση.

- Llama Guard: Εντοπίζει προβληματικό περιεχόμενο, όπως εγκληματική δραστηριότητα, παραβιάσεις πνευματικών δικαιωμάτων, μίσος, αυτοτραυματισμό και σεξουαλική κακοποίηση.

Οι προγραμματιστές μπορούν να προσαρμόσουν τις κατηγορίες αποκλεισμού περιεχομένου και να τις εφαρμόσουν σε όλες τις γλώσσες που υποστηρίζει το Llama. Το Prompt Guard μπλοκάρει κακόβουλα prompts, ενώ το Llama Firewall προστατεύει από κινδύνους όπως prompt injection και μη ασφαλή εργαλεία. Το Code Shield προσφέρει ασφαλή εκτέλεση εντολών σε επτά γλώσσες προγραμματισμού. Το CyberSecEval λειτουργεί ως σύνολο δεικτών για την αξιολόγηση της ασφάλειας του μοντέλου.

Περιορισμοί και προκλήσεις του Llama

Όπως όλα τα μοντέλα γενετικής τεχνητής νοημοσύνης, το Llama έχει περιορισμούς και κινδύνους. Παρά τις πολυτροπικές δυνατότητες, αυτές περιορίζονται κυρίως στην αγγλική γλώσσα. Η εκπαίδευση του μοντέλου βασίστηκε και σε πειρατικά e-books και άρθρα, με δικαστική απόφαση να θεωρεί τη χρήση αυτή “θεμιτή”. Ωστόσο, αν το Llama παράγει αποσπάσματα με πνευματικά δικαιώματα που χρησιμοποιηθούν εμπορικά, μπορεί να υπάρξουν νομικές συνέπειες.

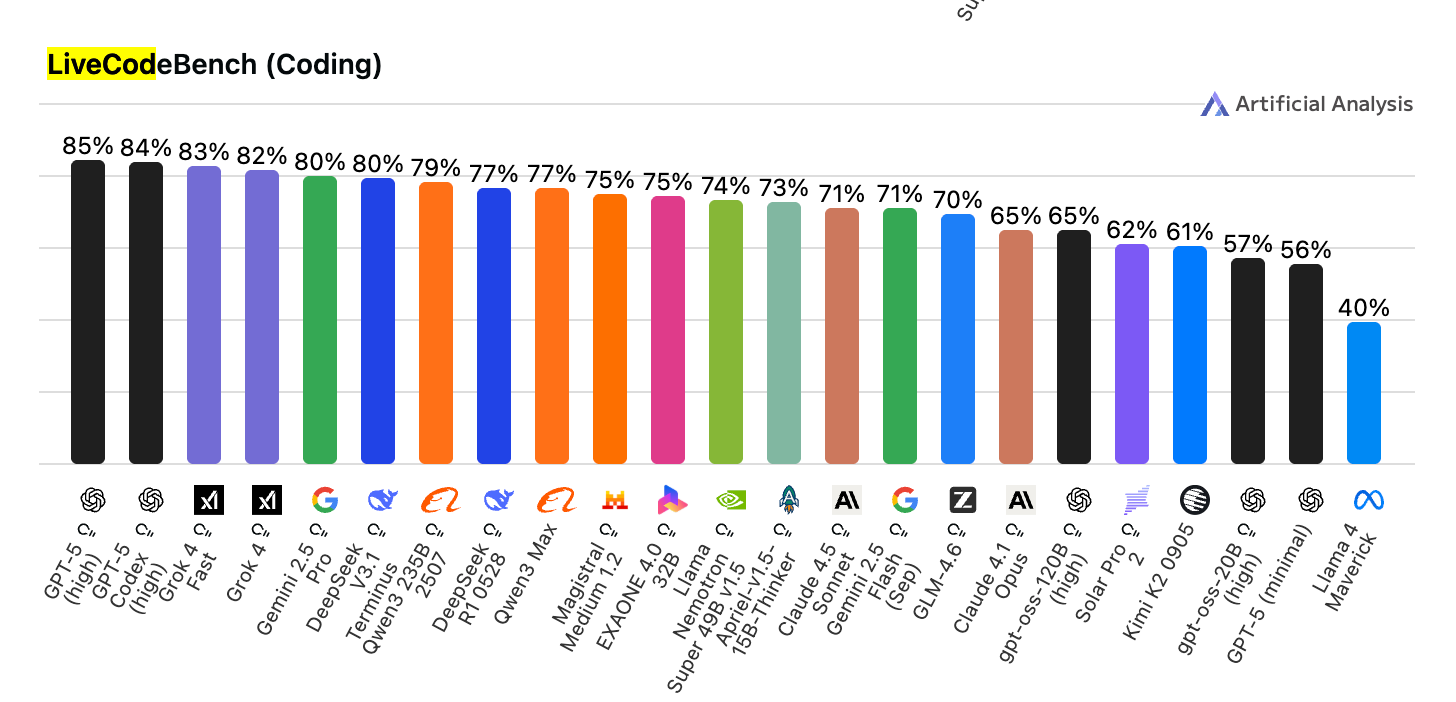

Στον προγραμματισμό, το Llama ενδέχεται να παράγει σφάλματα ή μη ασφαλή κώδικα. Σε δοκιμές, το Llama 4 Maverick πέτυχε σκορ 40% σε διαγωνισμούς προγραμματισμού, έναντι 85% για το GPT-5 high και 83% για το Grok 4 Fast. Είναι σημαντικό κάθε κώδικας που παράγεται από AI να ελέγχεται από ειδικό πριν χρησιμοποιηθεί.

Τέλος, όπως και άλλα μοντέλα AI, το Llama μπορεί να παράγει πειστικές αλλά λανθασμένες ή παραπλανητικές πληροφορίες, είτε σε νομικά, είτε σε τεχνικά, είτε σε συναισθηματικά ζητήματα.

Συνεχής ενημέρωση

Το άρθρο δημοσιεύτηκε αρχικά στις 8 Σεπτεμβρίου 2024 και ενημερώνεται τακτικά με νέες πληροφορίες.